시작은 ChatGPT 에서 단순한 사칙 연산 계산을 틀리는 상황이 자주 발생하게 됩니다.

LLM 특성이 계산과 같은 정확성에 어울리지 않는다는건 상식이겠으나 부족한 부분들은 별도로 처리하더라도 충족되어야할 부분일것으로 예상됩니다.

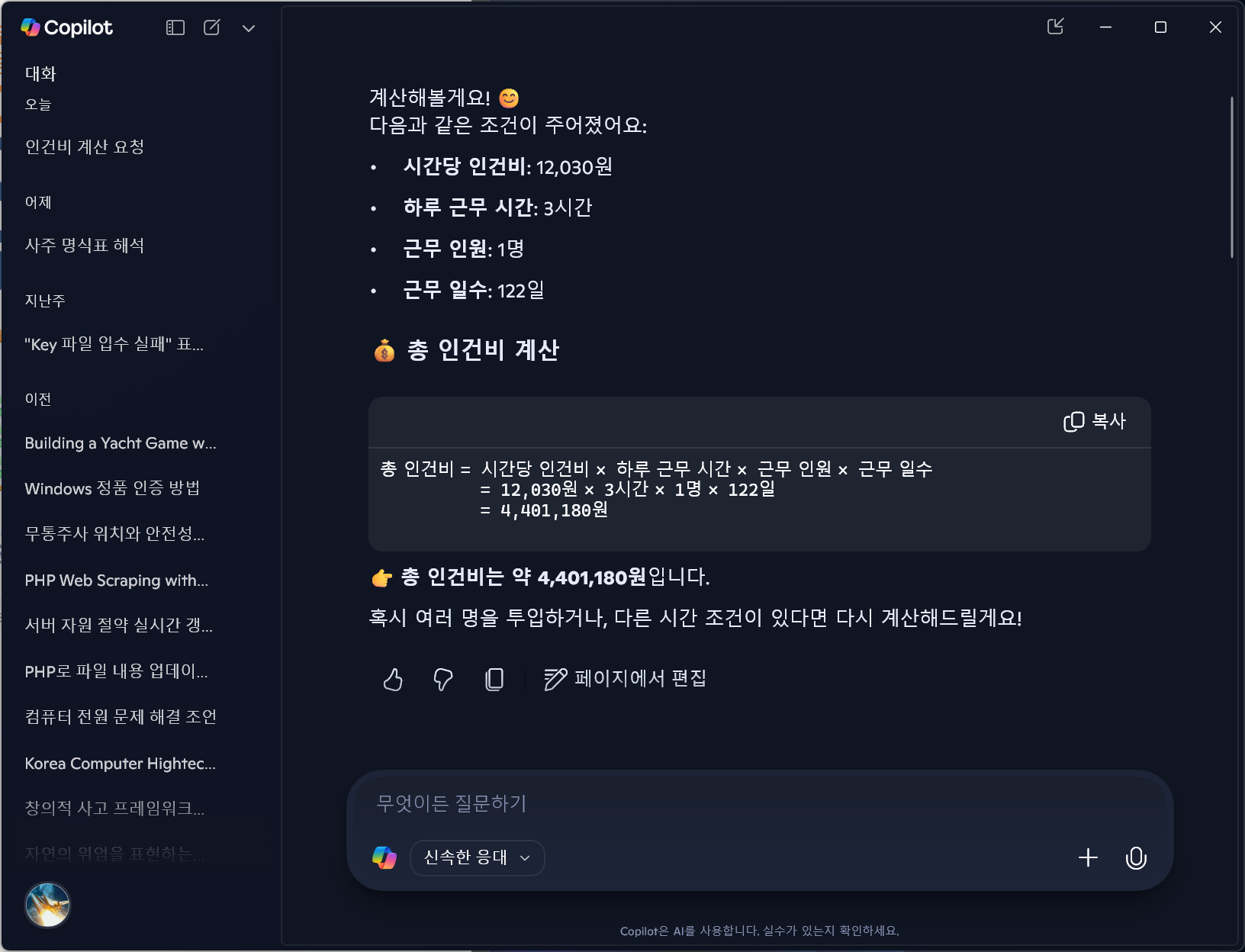

그에 따라 다른 언어 모델에서도 테스트 해봤는데 역시나

12030 * 3 * 122 라는 계산을 4,401,180으로 계산 하는 코파일럿

제미나이나 여러 인공지능에서 테스트 해봤는데 역시나 틀리는 AI 툴도 있고, 맞는 AI툴도 있었습니다. ChatGPT 버전에 따라 패치 이후 정확하게 답변하는 경우도 생겼고요..

즉 인공지능은 정답을 알려주는게 아니라 정답을 향해 추론해가는 아직은 시기상조의 과도기적인 물건일뿐입니다.

여러 분야에서 도움을 받아 업무 효율 향상에 상당히 도움이 되는것도 사실이겠으나 , 원칙적으로 그걸 사용하는 사용자가 명확하게 알고 있어야 잘못된 부분은 수정해가며 사용해야할 보조적인 툴일뿐입니다.

최근 일부 AI를 신봉하는 부류가 나타나고 있는데 AI를 맹신하는 일은 없어야 할것입니다.

명제를 추론해가는 시스템이지 정답을 향해가는 시스템이 아님을 인지하고 사용해야 할것입니다.

이는 추론하는 과정에 의한 오류로 수학적으로 설명을 해보자면

수학적으로는 A=B 면 B=A도 당연하다고 보겠으나 추론을 수학적으로 보자면 아닐수도 있다는 문제가 발생하게 됩니다.

A그룹은 B그룹이다라는 명제가 있을때 B그룹은 A그룹이 아닐수도 있는 상황이겠죠..

A그룹(1~10) = B그룹(1~100) 이라는건 맞는 추론 이겠으나 거꾸로

B그룹(1~100) = A그룹(1~10)이 아닐 가능성이 90%가 됨으로 수학적으로 그 다음 단계로 넘어가면 잘못될 가능성이 90%가 넘어가 버리게 됩니다. 오류라고 말할순 없겠으나 추론 과정과 순서에 따라 잘못된 방향으로 흘러갈수 있음을 이야기 하는것입니다.

그럼으로 2중 3중으로 확인하는 과정이 있어야 부수적인 문제가 발생하지 않을것입니다.

'PC > Software' 카테고리의 다른 글

| [소식] MS Windows 11 25H2 정식 출시 (0) | 2025.09.12 |

|---|---|

| [소개] 윈도우 사이즈 설정 유틸리티 Sizer4 (0) | 2025.09.09 |

| [팁] Bios 바로가기 만들기 (0) | 2025.08.24 |

| [소식] Total Commander 11.56 Final 정식 버전 출시 (3) | 2025.08.18 |

| [소개] 무료 Disk Clone Utility (디스크 복사) (0) | 2025.07.10 |

| [Tip] Stream Deck Mobile (모바일 기기로 스트림덱 흉내내기) (0) | 2025.06.30 |

댓글